原标题:Majorities of Americans are concerned about the spread of AI deepfakes and propaganda

文章来源:YouGov(June 29,2023)

全文约898字,阅读大约需3分钟。可通过点击文末“阅读全文”阅读报告原文。

新技术往往引发伦理争议,人工智能(AI)也不例外。最近的一项调查显示,美国人对AI的潜在用途表示担忧,尤其是在深度伪造(deepfakes)和政治宣传(propaganda)两方面。

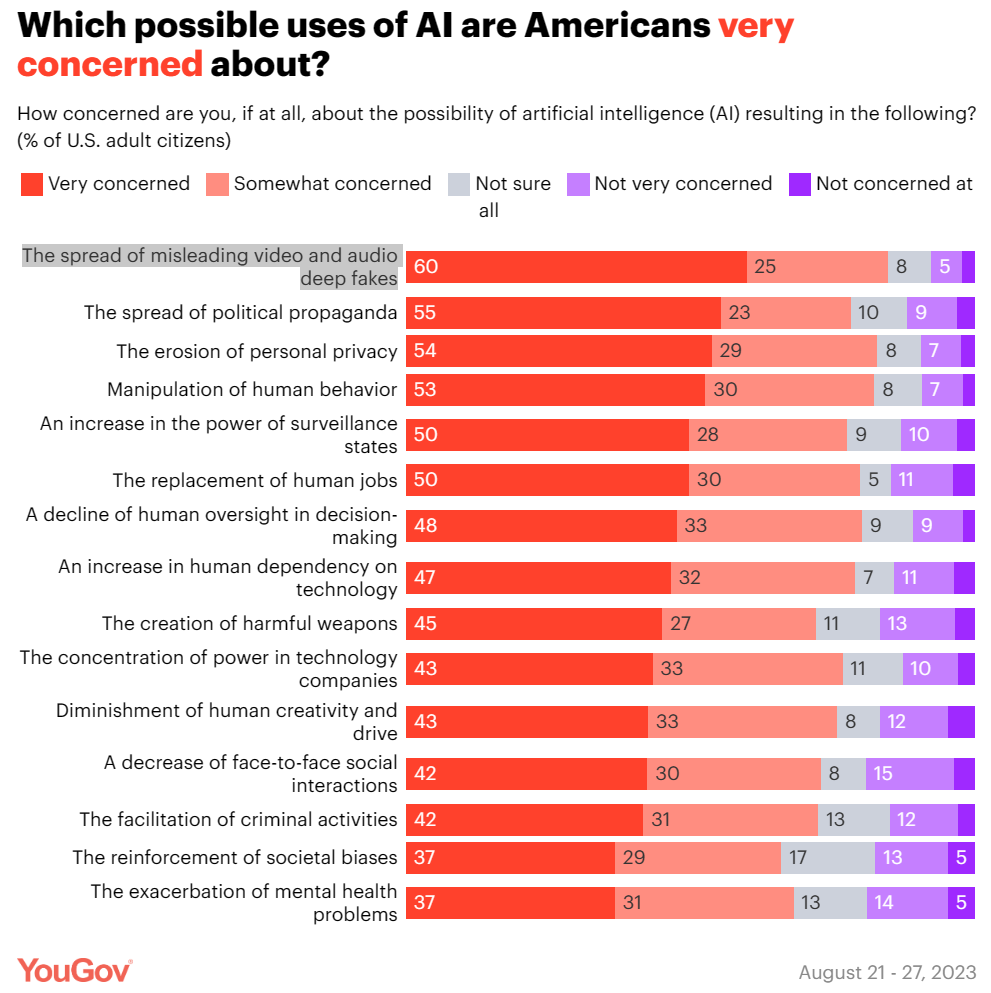

2023年4月份,美国舆观调查公司(YouGov)开展了一项针对1000名美国成年居民的问卷调查,以了解公众对AI潜在用途及其伦理问题的看法。调查结果显示,在调查者提供的15种AI的潜在用途中,受访者对“误导性音视频深度伪造的传播”及“政治宣传信息的传播”两方面的担忧情绪最为强烈。

一、受访者对AI潜在用途的担忧

逾三分之二的受访者表示,他们对调查中提及的所有AI潜在用途都有不同程度的担忧。60%的受访者表示,自己最为担心的是误导性AI音视频深度伪造的传播。至少一半的受访者尤为担心AI带来的政治宣传信息(55%),AI对个人隐私的侵犯(54%),AI对人类行为的操纵(53%),AI日益嵌入国家权力的运行(50%)以及其对人类工作岗位的替代性(50%)。此外,受访者针对AI导致心理健康问题恶化(37%)及社会偏见强化(37%)的担忧情绪较少,但占比也达到了三分之一。

值得一提的是,在YouGov公司开展的另一项调查中,绝大多数受访者(78%)希望对AI行业的监管更多、更严格;超半数受访者(57%)认为应暂停某些类型AI产品的开发。

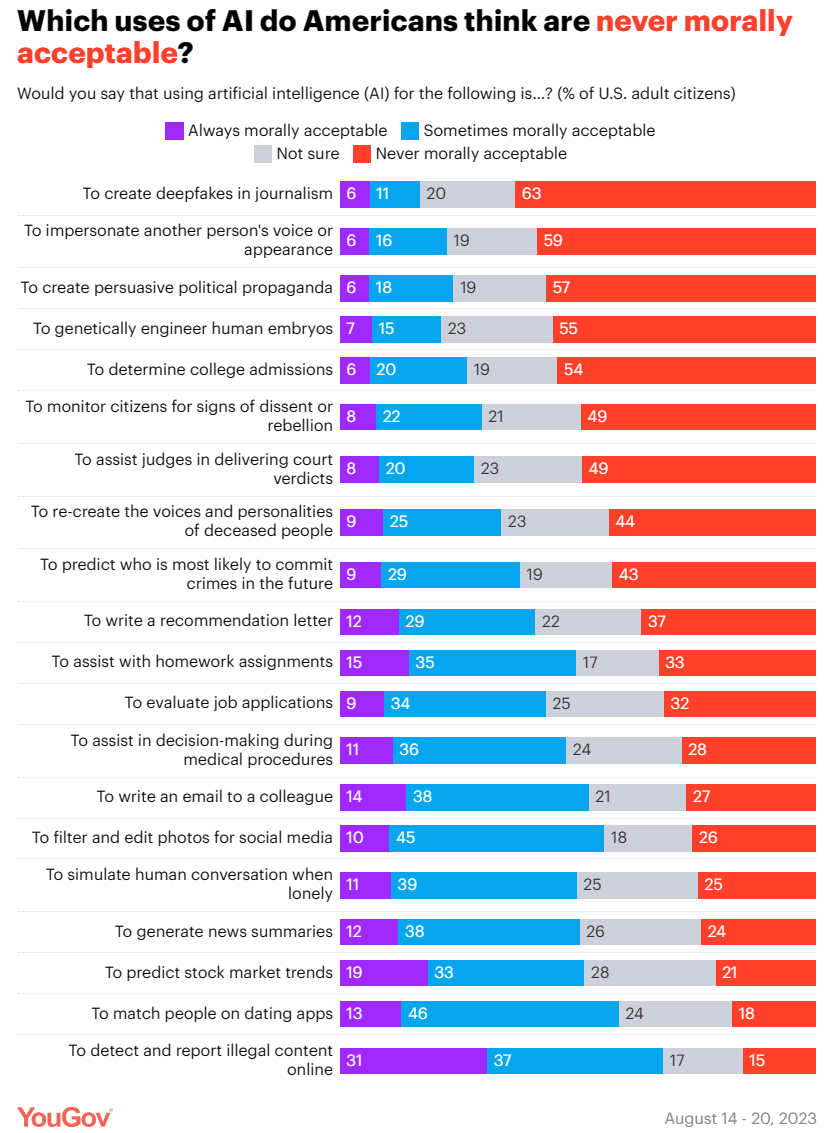

调查者还列举了AI可能存在的20种伦理风险,并询问受访者的看法。其中5种做法是他们断然不能接受的——使用AI制作深度伪造的新闻报道(63%),模仿某个真人的声音或外表(59%),营造有说服力的政治宣传(57%),对人类胚胎进行基因工程改造(55%)以及干预高校录取程序(54%)。

尽管AI总是面临着种种伦理争议,但它的某些用途也得到了公众的认可。例如,68% 的受访者表示,自己可以接受使用AI技术来监测和举报非法内容。此外,它还被认为能够用以促进某些类型的人际关系。例如,至少一半的受访者认为,在某些情况下,一个人寂寞时使用AI模拟人类对话(50%),给同事发送电子邮件(52%),或者在约会类APP上为人们牵线搭桥(59%)都是可以接受的。